Iklan

Selama beberapa bulan terakhir, Anda mungkin telah membaca liputan di sekitarnya sebuah artikel, ditulis bersama oleh Stephen Hawking, mendiskusikan risiko yang terkait dengan kecerdasan buatan. Artikel itu menyarankan bahwa AI dapat menimbulkan risiko serius bagi umat manusia. Hawking tidak sendirian di sana - Elon Musk dan Peter Thiel keduanya adalah tokoh publik intelektual yang telah menyatakan keprihatinan serupa (Thiel telah menginvestasikan lebih dari $ 1,3 juta untuk meneliti masalah ini dan kemungkinan solusinya).

Cakupan artikel Hawking dan komentar Musk telah, untuk tidak terlalu mempermasalahkan hal itu, sedikit riang. Nada suaranya sangat banyak "Lihat hal aneh ini yang membuat semua orang aneh ini khawatir." Sedikit pertimbangan diberikan pada gagasan bahwa jika beberapa orang terpintar di Bumi memperingatkan Anda bahwa sesuatu bisa sangat berbahaya, mungkin saja layak untuk didengarkan.

Ini bisa dimengerti - kecerdasan buatan mengambil alih dunia tentu terdengar sangat aneh dan tidak masuk akal, mungkin karena perhatian besar yang telah diberikan kepada ide ini oleh fiksi ilmiah penulis. Jadi, apa yang membuat semua orang yang rasional dan waras ini ketakutan?

Apa itu Kecerdasan?

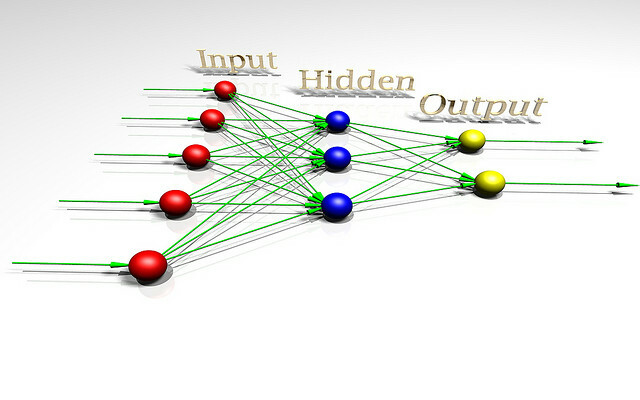

Untuk berbicara tentang bahaya Kecerdasan Buatan, mungkin bermanfaat untuk memahami apa itu kecerdasan. Untuk lebih memahami masalah ini, mari kita lihat arsitektur AI mainan yang digunakan oleh para peneliti yang mempelajari teori penalaran. AI mainan ini disebut AIXI, dan memiliki sejumlah sifat yang bermanfaat. Sasarannya bisa sewenang-wenang, berskala baik dengan daya komputasi, dan desain internalnya sangat bersih dan mudah.

Selain itu, Anda dapat mengimplementasikan versi arsitektur sederhana dan praktis yang dapat melakukan hal-hal seperti main Pacman, jika kamu mau. AIXI adalah produk dari peneliti AI bernama Marcus Hutter, yang bisa dibilang ahli terkemuka dalam kecerdasan algoritmik. Itu dia yang berbicara di video di atas.

Secara mengejutkan AIXI sederhana: ia memiliki tiga komponen inti: pelajar, perencana, dan fungsi utilitas.

- Itu pelajar mengambil string bit yang sesuai dengan input tentang dunia luar, dan mencari melalui program komputer sampai menemukan yang menghasilkan pengamatan sebagai output. Program-program ini, bersama-sama, memungkinkannya membuat perkiraan tentang seperti apa masa depan, hanya dengan menjalankan masing-masing program program maju dan bobot probabilitas hasil dengan panjang program (implementasi Occam's Pisau cukur).

- Itu perencana mencari melalui tindakan yang mungkin bahwa agen dapat mengambil, dan menggunakan modul pelajar untuk memprediksi apa yang akan terjadi jika mengambil masing-masing. Kemudian menilai mereka berdasarkan seberapa baik atau buruk hasil yang diprediksi, dan memilih jalannya tindakan yang memaksimalkan kebaikan hasil yang diharapkan dikalikan dengan probabilitas yang diharapkan dari mencapainya.

- Modul terakhir, yaitu fungsi utilitas, adalah program sederhana yang menggambarkan keadaan masa depan dunia, dan menghitung skor utilitas untuknya. Skor utilitas ini adalah seberapa baik atau buruk hasilnya, dan digunakan oleh perencana untuk mengevaluasi keadaan dunia masa depan. Fungsi utilitas dapat berubah-ubah.

- Secara keseluruhan, ketiga komponen ini membentuk sebuah pengoptimal, yang mengoptimalkan untuk tujuan tertentu, terlepas dari dunia tempat ia berada.

Model sederhana ini mewakili definisi dasar agen yang cerdas. Agen mempelajari lingkungannya, membuat modelnya, dan kemudian menggunakan model itu untuk menemukan arah tindakan yang akan memaksimalkan peluangnya mendapatkan apa yang diinginkannya. AIXI memiliki struktur yang mirip dengan AI yang bermain catur, atau game lain dengan aturan yang diketahui - kecuali bahwa AIXI dapat menyimpulkan aturan permainan dengan memainkannya, mulai dari nol pengetahuan.

AIXI, diberikan waktu yang cukup untuk menghitung, dapat belajar untuk mengoptimalkan sistem apa pun untuk tujuan apa pun, betapapun kompleksnya. Ini adalah algoritma yang umumnya cerdas. Perhatikan bahwa ini tidak sama dengan memiliki kecerdasan seperti manusia (AI yang diilhami secara biologis adalah a topik yang berbeda sama sekali Giovanni Idili dari OpenWorm: Otak, Cacing, dan Kecerdasan BuatanMensimulasikan otak manusia adalah jalan keluar, tetapi proyek sumber terbuka mengambil langkah-langkah penting pertama, dengan mensimulasikan neurologi dan fisiologi salah satu hewan paling sederhana yang dikenal dalam ilmu pengetahuan. Baca lebih banyak ). Dengan kata lain, AIXI mungkin dapat mengecoh manusia mana pun pada tugas intelektual apa pun (diberi daya komputasi yang cukup), tetapi mungkin tidak sadar akan kemenangannya Mesin Berpikir: Apa yang Dapat Diajar Neuroscience dan Kecerdasan Buatan tentang KesadaranBisakah membangun mesin dan perangkat lunak yang secara artifisial mengajari kita tentang cara kerja kesadaran, dan sifat dari pikiran manusia itu sendiri? Baca lebih banyak .

Sebagai AI praktis, AIXI memiliki banyak masalah. Pertama, ia tidak memiliki cara untuk menemukan program-program yang menghasilkan keluaran yang diminati. Ini adalah algoritma brute-force, yang artinya tidak praktis jika Anda tidak memiliki komputer yang kuat dan sembarangan. Setiap implementasi aktual AIXI adalah suatu keharusan perkiraan, dan (hari ini) umumnya yang cukup kasar. Namun, AIXI memberi kita sekilas teoritis tentang seperti apa kecerdasan buatan yang kuat akan terlihat, dan bagaimana itu bisa beralasan.

Ruang Nilai

Jika Anda sudah melakukan pemrograman komputer apa pun Dasar-Dasar Pemrograman Komputer 101 - Variabel Dan Tipe DataSetelah memperkenalkan dan berbicara sedikit tentang Pemrograman Berorientasi Objek sebelum dan di mana namanya berasal dari, saya pikir sudah saatnya kita pergi melalui dasar-dasar pemrograman mutlak dalam non-bahasa spesifik cara. Ini... Baca lebih banyak , Anda tahu bahwa komputer itu menjengkelkan, pedantis, dan mekanis literal. Mesin tidak tahu atau tidak peduli apa yang Anda inginkan: ia hanya melakukan apa yang diperintahkan. Ini adalah gagasan penting ketika berbicara tentang kecerdasan mesin.

Dengan mengingat hal ini, bayangkan bahwa Anda telah menemukan kecerdasan buatan yang kuat - Anda muncul dengan algoritma pintar untuk menghasilkan hipotesis yang cocok dengan data Anda, dan untuk menghasilkan kandidat yang baik rencana. AI Anda dapat memecahkan masalah umum, dan dapat melakukannya secara efisien pada perangkat keras komputer modern.

Sekarang saatnya memilih fungsi utilitas, yang akan menentukan nilai AI. Apa yang harus Anda minta untuk dihargai? Ingat, mesin akan menjengkelkan, pedant literal tentang fungsi apa pun yang Anda minta untuk memaksimalkan, dan tidak akan pernah berhenti - tidak ada hantu di mesin yang akan 'bangun' dan memutuskan untuk mengubah fungsi utilitasnya, terlepas dari berapa banyak peningkatan efisiensi yang dibuatnya sendiri pemikiran.

Eliezer Yudkowsky begini:

Seperti dalam semua pemrograman komputer, tantangan mendasar dan kesulitan mendasar AGI adalah bahwa jika kita menulis kode yang salah, AI tidak akan secara otomatis memeriksa kode kita, menandai kesalahan, mencari tahu apa yang sebenarnya kita katakan, dan melakukan itu sebagai gantinya. Non-programmer terkadang membayangkan AGI, atau program komputer secara umum, sebagai analog dengan pelayan yang mengikuti perintah tanpa pertanyaan. Tetapi bukan berarti AI itu mutlak taat ke kodenya; melainkan AI saja adalah Kode.

Jika Anda mencoba untuk mengoperasikan pabrik, dan Anda memberi tahu mesin untuk menilai pembuatan penjepit kertas, dan kemudian memberinya kendali atas sekelompok robot pabrik, Anda mungkin kembali keesokan harinya untuk menemukan bahwa itu sudah kehabisan setiap bentuk lain dari bahan baku, membunuh semua karyawan Anda, dan membuat penjepit kertas dari mereka sisa. Jika, dalam upaya meluruskan kesalahan Anda, Anda memprogram ulang mesin untuk sekadar membuat semua orang bahagia, Anda dapat kembali keesokan harinya untuk menemukannya memasukkan kabel ke dalam otak orang.

Intinya di sini adalah bahwa manusia memiliki banyak nilai rumit yang kita asumsikan dibagi secara implisit dengan pikiran lain. Kami menghargai uang, tetapi kami lebih menghargai hidup manusia. Kami ingin bahagia, tetapi kami tidak selalu ingin memasukkan kabel ke otak kami untuk melakukannya. Kami tidak merasa perlu untuk mengklarifikasi hal-hal ini ketika kami memberikan instruksi kepada manusia lain. Namun, Anda tidak dapat membuat asumsi semacam ini, saat merancang fungsi utilitas mesin. Solusi terbaik di bawah matematika tanpa jiwa dari fungsi utilitas yang sederhana sering kali merupakan solusi yang akan dihindari manusia karena mengerikan secara moral.

Membiarkan mesin cerdas untuk memaksimalkan fungsi utilitas yang naif hampir selalu akan menjadi bencana besar. Seperti yang dikatakan oleh filsuf Oxford, Nick Bostom,

Kita tidak dapat dengan blak-blakan berasumsi bahwa suatu kecerdasan super akan selalu berbagi nilai akhir mana pun yang secara stereotip terkait dengan kebijaksanaan dan perkembangan intelektual pada manusia — keingintahuan ilmiah, kepedulian penuh belas kasihan terhadap orang lain, pencerahan spiritual dan kontemplasi, penolakan terhadap keinginan material, selera untuk budaya yang halus atau untuk kesenangan sederhana dalam hidup, kerendahan hati dan tidak mementingkan diri sendiri, dan sebagainya.

Untuk memperburuk keadaan, sangat, sangat sulit untuk menentukan daftar lengkap dan terperinci dari segala sesuatu yang dihargai orang. Ada banyak segi dalam pertanyaan ini, dan melupakan satu pun pun berpotensi menjadi bencana besar. Bahkan di antara yang kami sadari, ada kehalusan dan kerumitan yang membuatnya sulit untuk menuliskannya sebagai sistem persamaan yang bersih yang dapat kami berikan ke mesin sebagai fungsi utilitas.

Beberapa orang, setelah membaca ini, menyimpulkan bahwa membangun AI dengan fungsi utilitas adalah ide yang buruk, dan kita harus mendesainnya secara berbeda. Di sini, ada juga berita buruk - Anda dapat membuktikan, secara formal, itu agen apa pun yang tidak memiliki sesuatu yang setara dengan fungsi utilitas tidak dapat memiliki preferensi yang koheren tentang masa depan.

Perbaikan Diri Rekursif

Salah satu solusi untuk dilema di atas adalah dengan tidak memberikan kesempatan kepada agen AI untuk menyakiti orang: berikan mereka hanya sumber daya yang mereka butuhkan selesaikan masalah dengan cara yang Anda inginkan untuk diselesaikan, awasi mereka dengan cermat, dan jauhkan dari peluang untuk berbuat besar membahayakan. Sayangnya, kemampuan kami untuk mengontrol mesin cerdas sangat mencurigakan.

Bahkan jika mereka tidak jauh lebih pintar dari kita, ada kemungkinan mesin untuk "bootstrap" - mengumpulkan perangkat keras yang lebih baik atau melakukan perbaikan pada kode sendiri yang membuatnya bahkan lebih pintar. Ini dapat memungkinkan mesin untuk melompati kecerdasan manusia dengan banyak urutan besarnya, mengakali manusia dalam arti yang sama seperti manusia mengakali kucing. Skenario ini pertama kali diusulkan oleh seorang pria bernama I. J. Bagus, yang bekerja pada proyek Enigma crypt-analysis dengan Alan Turing selama Perang Dunia II. Dia menyebutnya "Ledakan Intelijen," dan menggambarkan masalah seperti ini:

Biarkan mesin ultra-cerdas diartikan sebagai mesin yang bisa jauh melampaui semua aktivitas intelektual siapa pun, betapapun cerdiknya. Karena desain mesin adalah salah satu dari aktivitas intelektual ini, mesin ultra-cerdas dapat merancang mesin yang lebih baik; maka tidak diragukan lagi akan ada "ledakan kecerdasan," dan kecerdasan manusia akan tertinggal jauh. Jadi, mesin ultra-cerdas pertama adalah penemuan terakhir yang perlu dibuat manusia, asalkan mesin itu cukup jinak.

Ini tidak menjamin bahwa ledakan kecerdasan mungkin terjadi di alam semesta kita, tetapi tampaknya memang mungkin. Seiring berjalannya waktu, komputer menjadi lebih cepat dan wawasan dasar tentang kecerdasan meningkat. Ini berarti bahwa persyaratan sumber daya untuk membuat lompatan terakhir ke jenderal, meningkatkan kecerdasan menurun lebih rendah dan lebih rendah. Pada titik tertentu, kita akan menemukan diri kita di dunia di mana jutaan orang dapat pergi ke Best Buy dan mengambil perangkat keras dan literatur teknis yang mereka butuhkan untuk membangun kecerdasan buatan yang dikembangkan sendiri, yang sudah kami bangun mungkin sangat berbahaya. Bayangkan sebuah dunia tempat Anda bisa membuat bom atom dari batang dan batu. Itulah masa depan yang sedang kita diskusikan.

Dan, jika sebuah mesin membuat lompatan itu, ia bisa dengan cepat melampaui spesies manusia dalam hal intelektual produktivitas, memecahkan masalah yang tidak bisa diselesaikan oleh satu miliar manusia, dengan cara yang sama seperti manusia dapat memecahkan masalah yang a miliar kucing tidak bisa.

Itu bisa mengembangkan robot yang kuat (atau bio atau nanoteknologi) dan secara relatif cepat mendapatkan kemampuan untuk membentuk kembali dunia sesuka hati, dan sangat sedikit yang bisa kita lakukan tentang itu. Kecerdasan seperti itu dapat menghilangkan Bumi dan bagian tata surya lainnya untuk suku cadang tanpa banyak kesulitan, dalam perjalanannya untuk melakukan apa pun yang kami perintahkan. Tampaknya perkembangan seperti itu akan menjadi bencana besar bagi kemanusiaan. Kecerdasan buatan tidak harus berbahaya untuk menghancurkan dunia, sekadar acuh tak acuh.

Seperti kata pepatah, "Mesin tidak mencintai atau membenci Anda, tetapi Anda terbuat dari atom yang dapat digunakan untuk hal-hal lain."

Penilaian Risiko dan Mitigasi

Jadi, jika kita menerima bahwa merancang kecerdasan buatan yang kuat yang memaksimalkan fungsi utilitas sederhana itu buruk, berapa banyak masalah yang kita hadapi? Berapa lama kita dapat sebelum membuat mesin seperti itu? Tentu saja sulit untuk mengatakannya.

Pengembang kecerdasan buatan adalah membuat kemajuan. 7 Website Menakjubkan Untuk Melihat Pemrograman Kecerdasan Buatan TerbaruInteligensi Buatan belum HAL dari tahun 2001: The Space Odyssey… tapi kami semakin dekat. Benar saja, suatu hari itu bisa sama dengan potboiler sci-fi yang diaduk oleh Hollywood ... Baca lebih banyak Mesin yang kami bangun dan masalah yang dapat mereka selesaikan telah tumbuh dengan mantap dalam cakupannya. Pada tahun 1997, Deep Blue bisa bermain catur di level yang lebih besar dari grandmaster manusia. Pada 2011, IBM Watson dapat membaca dan mensintesis informasi yang cukup dalam dan cukup cepat untuk mengalahkan manusia terbaik pemain di permainan tanya jawab terbuka yang penuh dengan permainan kata dan permainan kata - itu banyak kemajuan dalam empat belas tahun.

Saat ini, Google berinvestasi dalam meneliti pembelajaran yang mendalam, suatu teknik yang memungkinkan pembangunan jaringan saraf yang kuat dengan membangun rantai jaringan saraf yang lebih sederhana. Investasi itu memungkinkannya untuk membuat kemajuan serius dalam pidato dan pengenalan gambar. Akuisisi terbaru mereka di area tersebut adalah startup Deep Learning bernama DeepMind, yang mereka bayarkan sekitar $ 400 juta. Sebagai bagian dari ketentuan perjanjian, Google setuju untuk membuat dewan etika untuk memastikan bahwa teknologi AI mereka dikembangkan dengan aman.

Pada saat yang sama, IBM sedang mengembangkan Watson 2.0 dan 3.0, sistem yang mampu memproses gambar dan video dan berdebat untuk mempertahankan kesimpulan. Mereka memberikan demo sederhana awal tentang kemampuan Watson untuk mensintesis argumen untuk dan melawan topik dalam demo video di bawah ini. Hasilnya tidak sempurna, tetapi langkah yang mengesankan tidak peduli

Tidak satu pun dari teknologi ini yang berbahaya saat ini: kecerdasan buatan sebagai suatu bidang masih berjuang untuk menyamai kemampuan yang dikuasai oleh anak-anak kecil. Pemrograman komputer dan desain AI adalah keterampilan kognitif tingkat tinggi yang sangat sulit, dan kemungkinan akan menjadi tugas manusia terakhir yang menjadi keahlian mesin. Sebelum kita sampai ke titik itu, kita juga akan memiliki mesin di mana-mana yang bisa mengemudi Inilah Cara Kami Akan Menuju Dunia yang Penuh Dengan Mobil Tanpa DriverMengemudi adalah tugas yang membosankan, berbahaya, dan berat. Bisakah suatu hari diotomatisasi oleh teknologi mobil tanpa pengemudi Google? Baca lebih banyak , praktik kedokteran dan hukum, dan mungkin hal-hal lain juga, dengan konsekuensi ekonomi yang mendalam.

Waktu yang diperlukan untuk mencapai titik perubahan peningkatan diri hanya bergantung pada seberapa cepat kita memiliki ide-ide bagus. Meramalkan kemajuan teknologi semacam itu sangat sulit. Tampaknya tidak masuk akal bahwa kita mungkin dapat membangun AI yang kuat dalam waktu dua puluh tahun, tetapi juga tampaknya tidak masuk akal bahwa mungkin perlu delapan puluh tahun. Bagaimanapun, itu akan terjadi pada akhirnya, dan ada alasan untuk percaya bahwa ketika itu terjadi, itu akan sangat berbahaya.

Jadi, jika kita menerima bahwa ini akan menjadi masalah, apa yang bisa kita lakukan? Jawabannya adalah untuk memastikan bahwa mesin cerdas pertama aman, sehingga mereka dapat melakukan bootstrap hingga tingkat kecerdasan yang signifikan, dan kemudian melindungi kami dari mesin tidak aman yang dibuat kemudian. 'Keamanan' ini didefinisikan dengan membagikan nilai-nilai kemanusiaan, dan bersedia melindungi dan membantu umat manusia.

Karena kita tidak bisa benar-benar duduk dan memprogram nilai-nilai manusia ke dalam mesin, mungkin perlu untuk merancang fungsi utilitas yang mengharuskan mesin untuk amati manusia, simpulkan nilai-nilai kita, dan kemudian coba maksimalkan. Untuk membuat proses pengembangan ini aman, mungkin juga berguna untuk mengembangkan kecerdasan buatan yang dirancang khusus tidak untuk memiliki preferensi tentang fungsi utilitas mereka, memungkinkan kami untuk memperbaikinya atau mematikannya tanpa perlawanan jika mereka mulai tersesat selama pengembangan.

Banyak masalah yang perlu kita selesaikan untuk membangun kecerdasan mesin yang aman sulit secara matematis, tetapi ada alasan untuk percaya bahwa mereka dapat diselesaikan. Sejumlah organisasi berbeda sedang menangani masalah ini, termasuk Future of Humanity Institute di Oxford, dan Lembaga Penelitian Kecerdasan Mesin (yang didanai Peter Thiel).

MIRI tertarik secara khusus dalam mengembangkan matematika yang dibutuhkan untuk membangun AI yang Ramah. Jika ternyata kecerdasan buatan bootstrap adalah mungkin, maka kembangkan semacam ini Teknologi 'Ramah AI' pertama, jika berhasil, mungkin akhirnya menjadi satu-satunya hal terpenting yang dimiliki manusia pernah dilakukan.

Apakah Anda pikir kecerdasan buatan itu berbahaya? Apakah Anda khawatir tentang apa yang akan terjadi pada masa depan AI? Sampaikan pendapatmu pada bagian komentar di bawah ini!

Kredit Gambar: Lwp Kommunikáció Via Flickr, “Jaringan syaraf", Oleh fdecomite," img_7801", Oleh Steve Rainwater," E-Volve ", oleh Keoni Cabral,"new_20x", Oleh Robert Cudmore,"Klip kertas“, Oleh Clifford Wallace

Seorang penulis dan jurnalis yang berbasis di Barat Daya, Andre dijamin tetap fungsional hingga 50 derajat Celcius, dan tahan air hingga kedalaman dua belas kaki.